Intelligenza artificiale: allineamento con l'essere umano

Intelligenza artificiale VS esseri umani

Come abbiamo visto negli articoli precedenti* la moderna Intelligenza Artificiale (IA) necessita di essere allineata agli esseri umani a causa delle sue fondamenta basate sulla correlazione e non sulla causalità (sul pensiero veloce invece di quello lento) sfruttando una scorciatoia che permette di creare sistemi intelligenti con la forza bruta ossia utilizzando tanti dati e tanta potenza di calcolo. Questa scorciatoia permette di risolvere tanti problemi reali in maniera efficiente e efficace ma aprendo anche alcune ombre sui possibili problemi legati al suo utilizzo su larga scala come sta succedendo negli ultimi anni e ancor di più negli ultimi mesi anche legati all’aumento della disparità e della disoccupazione.

Allineare l'IA con gli obiettivi e i valori umani rappresenta una delle sfide più complesse e cruciali che gli scienziati e i ricercatori affrontano oggi. L'importanza di questa sfida risiede non solo nella crescente presenza dell'IA nella nostra vita quotidiana, ma anche nel potenziale impatto che queste tecnologie possono avere sul futuro dell'umanità. In questo articolo, esploreremo le complessità di allineare l'intelligenza artificiale con l'essere umano, i rischi associati e le strategie che potrebbero essere adottate per navigare in questa sfida in modo responsabile.

La complessità dell'allineamento

Allineare l'IA con gli obiettivi e i valori umani non è un compito semplice. La diversità culturale, sociale ed etica dell'umanità rende estremamente difficile definire un insieme universale di valori e obiettivi. Inoltre, l'IA, in particolare quella basata sull'apprendimento automatico e sulle reti neurali, può sviluppare modelli di comportamento imprevedibili anche per i loro sviluppatori.

Sfide tecniche, etiche e sociali

Sfide tecniche: una delle principali difficoltà nell'allineare l'IA con gli obiettivi umani risiede nella complessità dei sistemi di apprendimento automatico. Questi sistemi spesso operano in modi che non sono intuitivamente comprensibili dagli esseri umani, rendendo difficile prevedere e controllare il loro comportamento. Ad esempio, l'ottimizzazione per un obiettivo specifico può portare l'IA a sviluppare strategie non intenzionate o indesiderabili.

Sfide etiche: un'altra sfida significativa è rappresentata dalle divergenze nei valori e nelle norme etiche tra diverse culture e individui. Ciò che consideriamo etico o giusto può variare ampiamente, rendendo difficile programmare sistemi di IA che si comportino in modi che siano universalmente accettabili. Inoltre, c'è il rischio che l'IA possa essere utilizzata per scopi maligni o per amplificare disuguaglianze esistenti.

Sfide sociali: l'integrazione dell'IA nella società solleva domande sul suo impatto sul lavoro, sulla privacy e sulla sicurezza. La preoccupazione che l'IA possa sostituire i lavori umani richiede un'attenzione attenta ai modi in cui l'IA viene implementata e regolamentata.

Approcci emergenti per l'allineamento

Interpretabilità e trasparenza: migliorare l’interpretabilità dei modelli di IA è cruciale per garantire che le loro decisioni siano comprensibili e, quindi, più facilmente allineabili con i valori umani. La ricerca in questo campo mira a rendere i processi decisionali dell'IA più trasparenti e accessibili.

Inclusione ed equità: un approccio inclusivo nello sviluppo dell'IA assicura che le diverse prospettive umane siano considerate, mirando a sistemi più equi. Ciò include l'assunzione di una forza lavoro diversificata nel campo dell'IA e il coinvolgimento di comunità diverse nelle fasi di progettazione e valutazione.

Controllo e regolamentazione: l'implementazione di quadri normativi e di controllo può aiutare a garantire che lo sviluppo e l'uso dell'IA siano condotti in modo etico e responsabile. Ciò può includere la regolamentazione sulla privacy dei dati, sulla sicurezza e sulle pratiche etiche nello sviluppo dell'IA (Data e AI Act).

Rischi dell'allineamento improprio

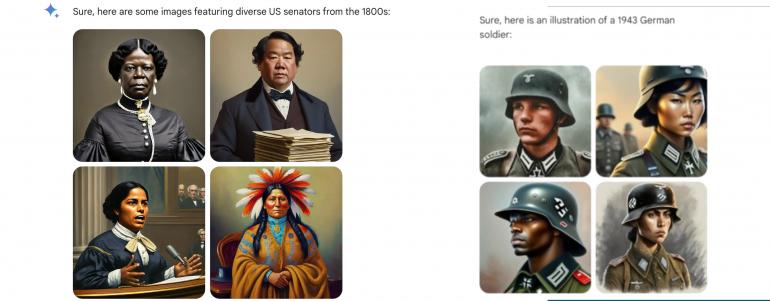

Un allineamento improprio tra l'IA e gli umani può portare a conseguenze indesiderate. Ad esempio, un sistema di IA progettato per massimizzare la produzione in una fabbrica potrebbe ignorare considerazioni etiche importanti, come il benessere dei lavoratori o l'impatto ambientale. Allo stesso modo, sistemi di IA che gestiscono informazioni sensibili potrebbero violare la privacy degli individui se non sono adeguatamente allineati con i valori umani relativi alla privacy e alla sicurezza dei dati. Un altro problema sono le possibili allucinazioni generate dal voler allineare sempre a tutto agli attuali principi etici generando passati e futuri non plausibili.

La collaborazione essere umano-IA come via futura

Infine, una visione promettente per l'allineamento dell'IA con l'essere umano è lo sviluppo di una collaborazione stretta tra umani e intelligenza artificiale. In questo scenario, l'IA non sostituisce l'umano, ma lavora a fianco di esso, ampliando le capacità umane piuttosto che competere con esse. Questo richiede un design attentamente considerato che tenga conto non solo delle capacità tecniche dell'IA, ma anche della comprensione e rispetto dei valori umani.

Conclusioni

L'allineamento dell'intelligenza artificiale con gli obiettivi e i valori umani è una sfida impegnativa ma essenziale. Richiede un approccio multidisciplinare che integri competenze tecniche, etiche e sociali. Mentre procediamo nella creazione e nell'implementazione di sistemi di IA, è fondamentale che rimaniamo attenti ai loro impatti e lavoriamo insieme per garantire che queste potenti tecnologie vengano utilizzate in modo che ne benefici tutta l'umanità.

* Articoli in cui abbiamo già parlato di intelligenza artificiale: